Si vous avez regardé les vidéos de lancement d'Adobe MAX 2020, vous avez probablement remarqué quelques tendances qui se forment lors des démonstrations de produits.

Mobile et social étaient (et seront toujours) des points focaux, mais l'intelligence artificielle (IA) et l'apprentissage automatique (ML) ou Sensei car Adobe a choisi de les marquer - a pris la scène de plusieurs manières surprenantes.

Comme toujours, une grande partie du temps d'antenne a été consacrée à Photoshop, qui a ajouté un ensemble d'outils pilotés par Sensei appelés Neural Filters qui incluent la mise à l'échelle de l'image, le remplacement du ciel et le vieillissement du portrait. Mais s'il est amusant d'avancer l'horloge sur votre visage et d'échanger cette ligne d'horizon époustouflante avec un coucher de soleil stock rend un paysage plus joli, il est difficile de voir beaucoup de valeur commerciale dans ces outils. Pour cela, vous devriez vous pencher sur la fonctionnalité d'intelligence artificielle dont on parle le moins dans Premiere Pro :la synthèse vocale.

Voyons pourquoi vous pourriez le vouloir, comment vous pourriez l'utiliser et si cet outil d'apprentissage automatique peut ou non augmenter votre productivité.

Nous n'en parlons pas

Prenons un moment pour rappeler qu'il ne s'agit pas de la première tentative d'Adobe de publier un outil permettant de convertir l'audio enregistré en texte modifiable. L'analyse de la parole a été ajoutée à Premiere Pro en 2013. Ce n'était... pas génial.

Lorsque je l'ai testé à l'époque, la meilleure description des résultats qu'il produisait serait une salade de mots.

Mais pour être juste, il en était de même pour d'autres logiciels à l'époque. La transcription automatique de Google pour les vidéos YouTube était tout aussi peu fiable. Comme l'a dit un commentateur "d'après mon expérience, il fait un si mauvais travail que le temps qu'il me faudrait pour le corriger est considérablement plus long que le temps qu'il me faudrait pour le transcrire moi-même."

Et cela, en un mot, était le problème. Il n'était donc pas vraiment surprenant qu'Adobe ait retiré l'analyse de la parole de la version publique en 2014 et soit resté silencieux sur la question jusqu'à ce que le fabuleux Jason Levine la remette sous les projecteurs en 2020.

Traits différents

La motivation pour générer automatiquement des sous-titres dépendra probablement de votre point de vue commercial.

Par exemple, des entreprises comme Google et Facebook le veulent parce qu'il rend la vidéo indexable et consultable, nous permettant de trouver du contenu à l'intérieur des vidéos (et pour eux de vendre des espaces publicitaires en fonction du contexte).

Mais pour les producteurs et distributeurs de vidéos, le besoin de sous-titres vient probablement d'un autre endroit.

Accessibilité

Les lois sur l'accessibilité sont différentes à travers le monde, mais ce qui se rapproche le plus d'une norme mondiale, ce sont les directives pour l'accessibilité des contenus Web (WCAG) publiées par le World Wide Web Consortium (W3C). Il convient de noter que la section 7.3 des WCAG actuelles indique que les médias sans sous-titres sont considérés comme une erreur critique qui fait automatiquement échouer le processus de notation.

Aux États-Unis, la FCC a déjà établi une obligation légale selon laquelle tout le contenu télévisé diffusé en Amérique doit être sous-titré, et toute diffusion ultérieure de ce contenu relève des mêmes règles.

Et s'il est vrai que le contenu diffusé uniquement sur Internet ne relève pas de ces réglementations, la législation, y compris l'Americans with Disabilities Act (ADA), a déjà été utilisée avec succès comme base de poursuites contre des plateformes de streaming comme Netflix et Hulu.

Donc, de nos jours, il est probablement plus sûr de supposer que les sous-titres sont requis par la loi dans le pays/l'état où vous opérez plutôt que de le découvrir à la dure.

Médias sociaux

Bien que le respect des exigences d'accessibilité soit une excellente justification du sous-titrage, il est également bénéfique pour les publics qui ne souffrent pas de perte auditive, en particulier lorsqu'il s'agit de vidéos sur les réseaux sociaux.

La lecture automatique en sourdine devient rapidement la norme pour la vidéo dans les flux sociaux défilants, et on estime que jusqu'à 85 % des visionnages de vidéos ont lieu avec le son désactivé. Ainsi, si vous souhaitez améliorer le rapport signal/bruit de votre contenu sur les réseaux sociaux, les sous-titres font désormais partie intégrante du processus.

Portée mondiale

Et pour ceux d'entre nous qui travaillent avec les marchés mondiaux, on sait depuis longtemps que les sous-titres sont le moyen le plus simple de réutiliser votre contenu de film et de vidéo pour un public qui parle une langue différente. (Certainement beaucoup moins impliqué que le doublage et l'ADR.)

Alors que certains services de traduction peuvent travailler directement à partir du support d'origine, proposer un fichier de sous-titres dans la langue d'origine peut aider à accélérer le processus.

Il y a, bien sûr, d'autres raisons pour lesquelles les sous-titres deviennent rapidement un élément essentiel de la production médiatique, et ce n'est pas seulement à cause des mèmes.

Mais même si les besoins peuvent varier d'une entreprise à l'autre, l'avantage fondamental est le même :le sous-titrage de vos médias vous aidera à atteindre un public plus large. Et c'est bon pour tout le monde .

Commençons le spectacle

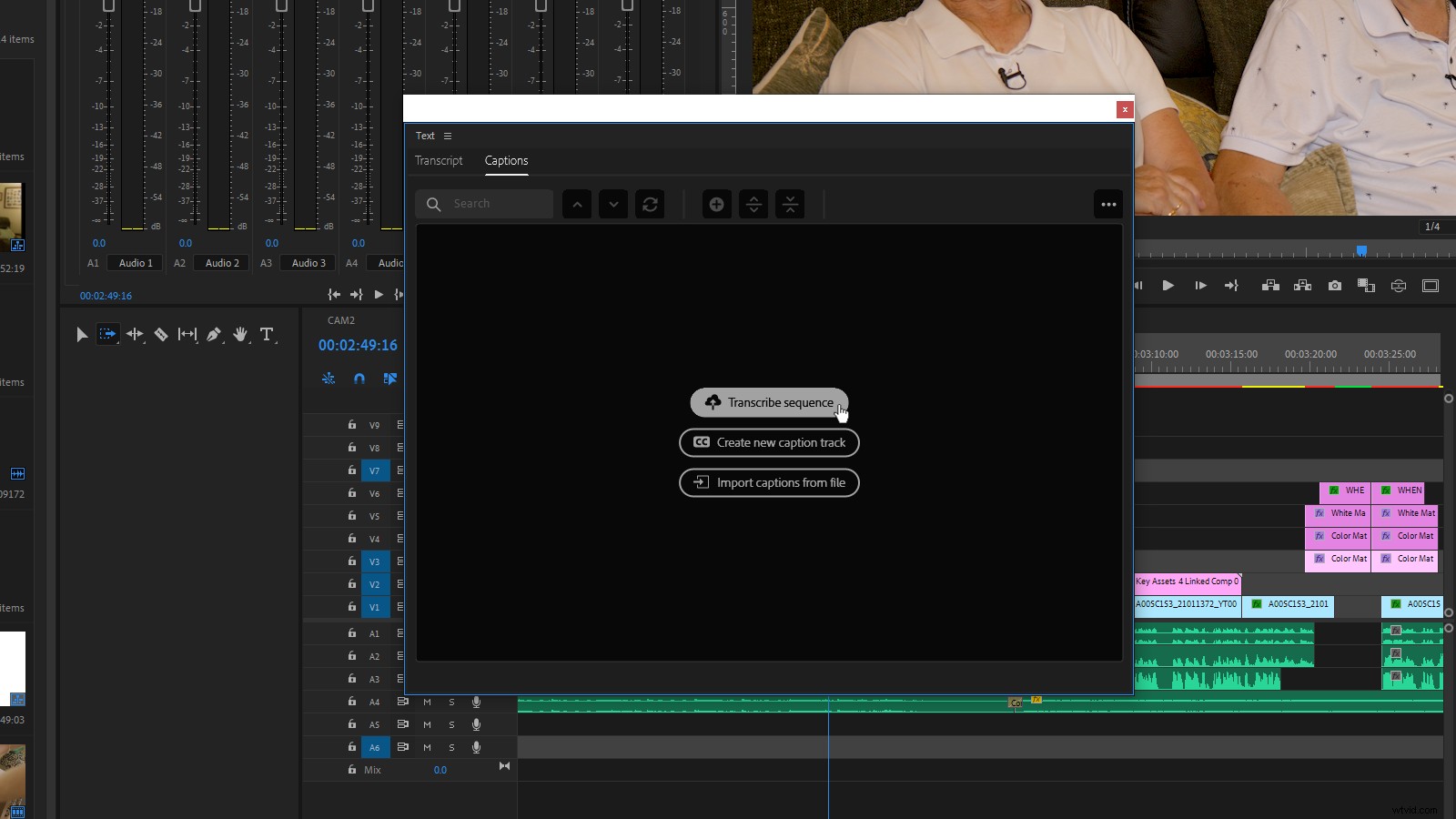

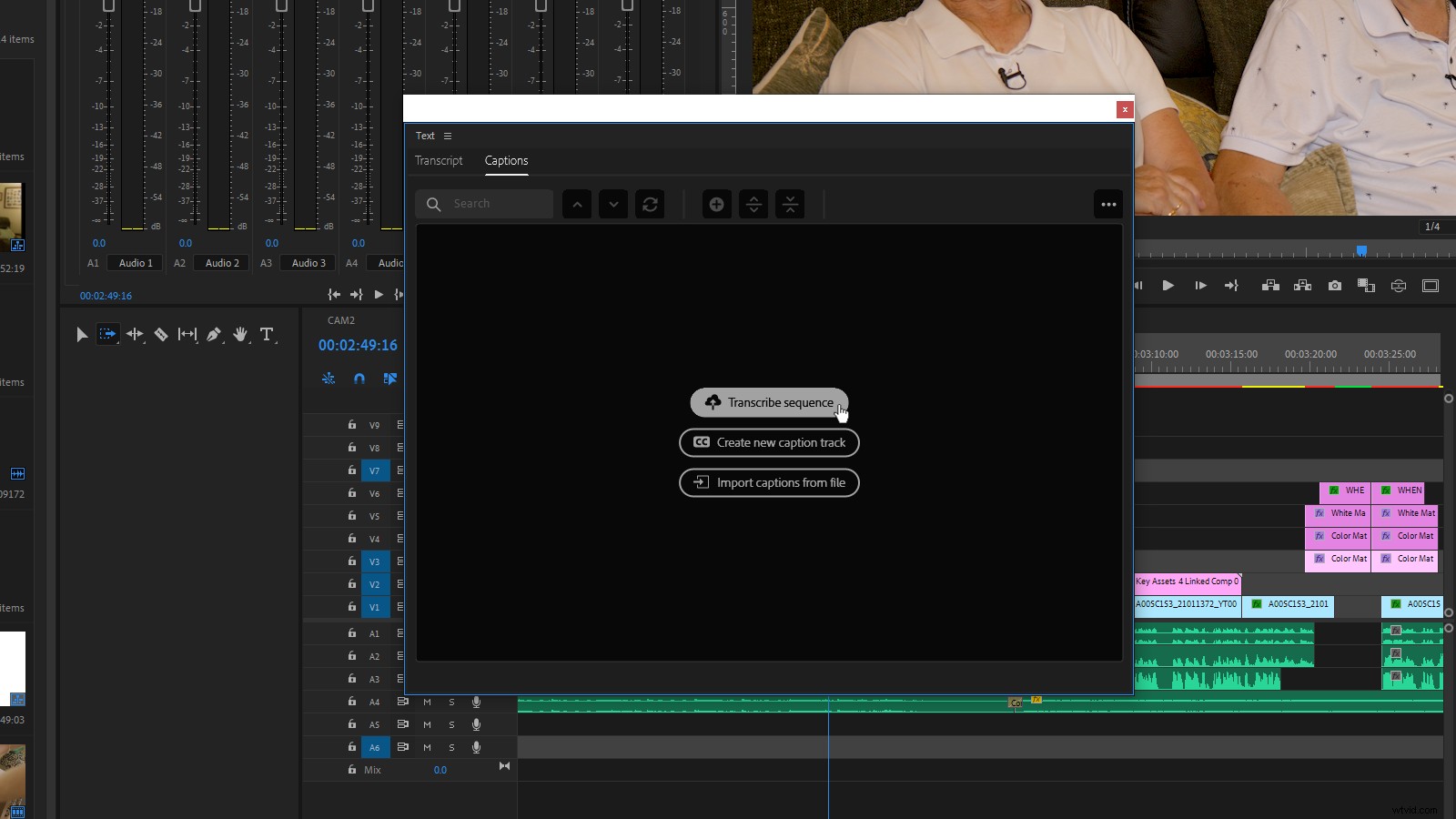

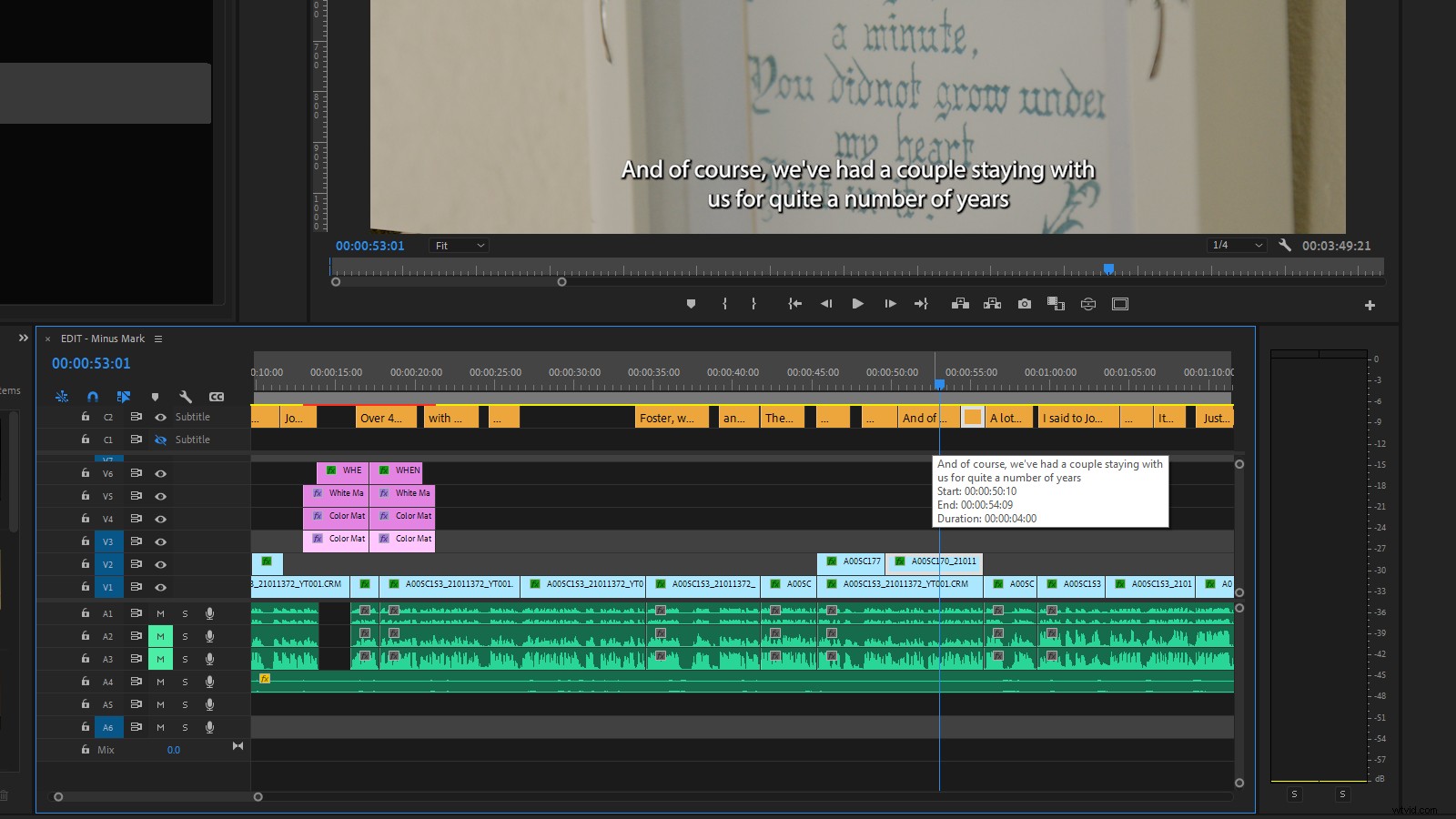

Pour commencer, ouvrez le projet à sous-titrer dans Premiere Pro et activez la séquence cible dans la vue Montage.

Selon la façon dont vous avez structuré votre modification, une petite préparation peut être bénéfique avant d'aller de l'avant.

Par exemple, si vous avez disposé plusieurs voix sur des pistes distinctes, ou si vous avez un mélange de voix et de SFX/musique sur la même piste, vous devriez passer un peu de temps à marquer les clips vocaux comme Dialogue à l'aide du panneau Audio essentiel (vous pouvez également choisir de désactiver toutes les pistes indésirables sur la chronologie si c'est plus facile.) Cela permettra à Premiere Pro de savoir quels éléments inclure dans l'audio exporté qui il analyse plus tard.

De plus, si vous ne souhaitez pas créer de sous-titres pour toute la séquence, vous devez définir les points d'entrée et de sortie de la séquence en déplaçant la tête de lecture sur les positions requises et en appuyant respectivement sur les touches I et O. (Notez que la barre de la zone de travail n'est pas utilisée pour cette fonctionnalité.)

Lorsque vous êtes prêt, ouvrez la fenêtre Texte (Fenêtre->Texte) et cliquez sur Transcrire la séquence bouton.

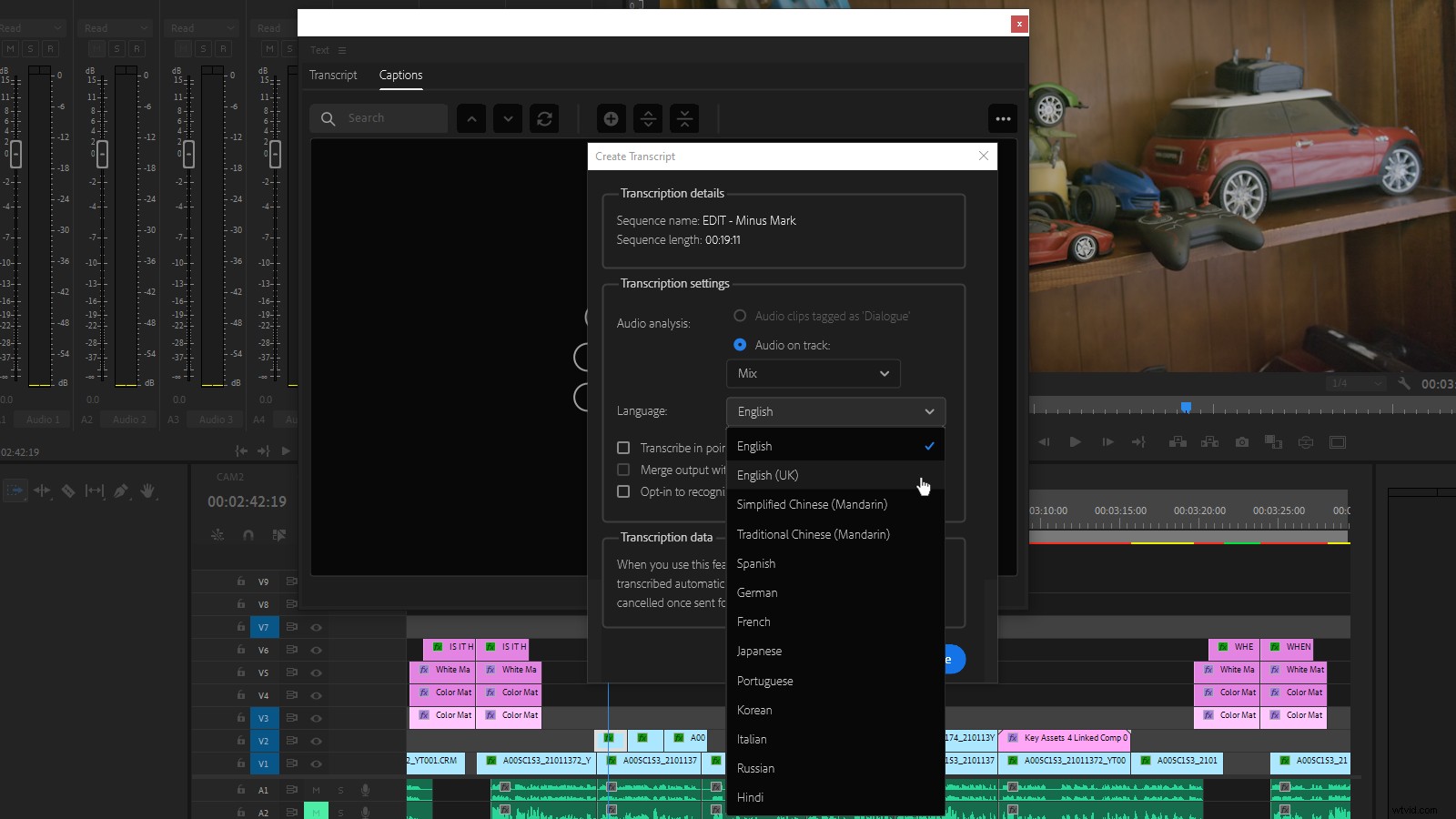

Vos options à ce stade sont simples. Vous pouvez choisir d'exporter un mixage des seuls clips que vous avez marqués comme Dialogue, vous pouvez choisir Mix pour créer un mixage de la séquence entière, ou vous pouvez sélectionner une piste spécifique à exporter dans le menu déroulant.

À l'heure actuelle, il n'y a aucun moyen de sélectionner plusieurs pistes audio pour le mixage, ce qui pourrait être fastidieux si vous avez plusieurs haut-parleurs sur des pistes distinctes. Pour l'instant, désactivez simplement les pistes que vous ne souhaitez pas inclure et choisissez l'option Mix.

Speech-to-Text prend en charge une sélection impressionnante de langues couvrant la majeure partie de la population mondiale. Les exceptions notables sont l'arabe, le bengali et l'indonésien, mais il est intéressant de voir les variantes américaines et britanniques de l'anglais. (En tant qu'expatrié britannique vivant en Australie, ce dernier marque des points bonus avec moi.) Cependant, je ne peux commenter l'efficacité de l'outil qu'en anglais.

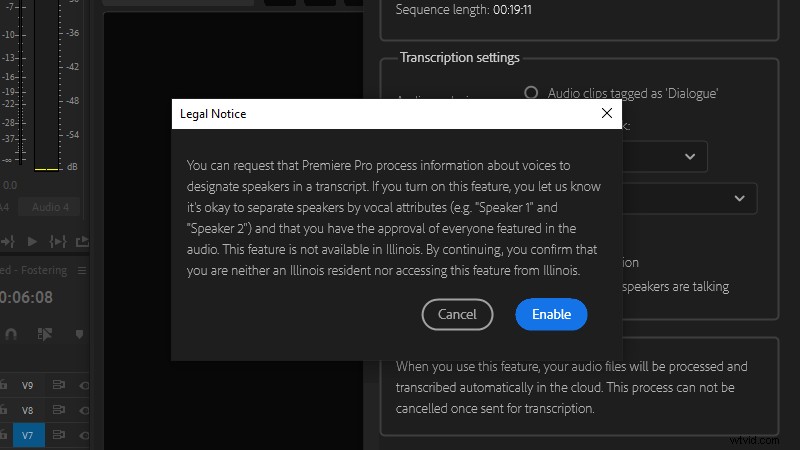

Il est intéressant de noter que la capacité de Sensei à identifier différents locuteurs (qui était le comportement par défaut dans la version bêta) nécessite désormais un consentement et n'est pas disponible dans l'Illinois, probablement en raison de problèmes de confidentialité.

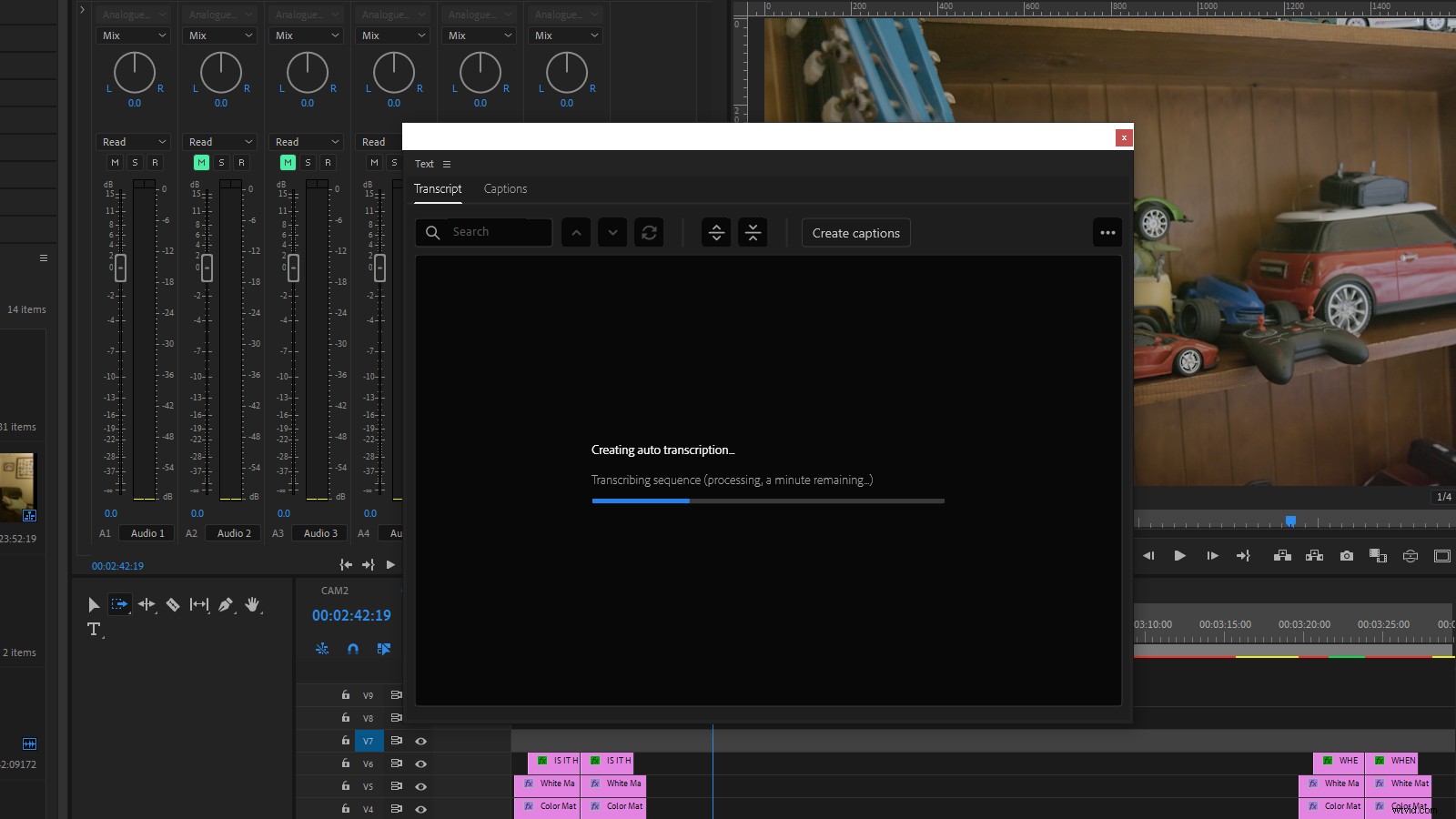

Le processus de transcription est relativement rapide, avec un projet de test de quatre minutes avec deux haut-parleurs prenant environ deux minutes et une séquence d'une heure prenant 24 minutes, ce qui indique un temps d'exécution d'environ la moitié du temps d'exécution.

Mais Speech-to-Text est (principalement) basé sur le cloud et il est impossible de prédire à quoi pourraient ressembler les vitesses si l'ensemble de l'adhésion à Adobe Creative Cloud commence soudainement à mâcher les cycles de calcul de Sensei en même temps. Cela dit, même si la mise en file d'attente des tâches devient nécessaire, vous et votre poste de travail serez au moins libres de faire ce café ou de rattraper d'autres tâches en attendant.

Retournez au travail

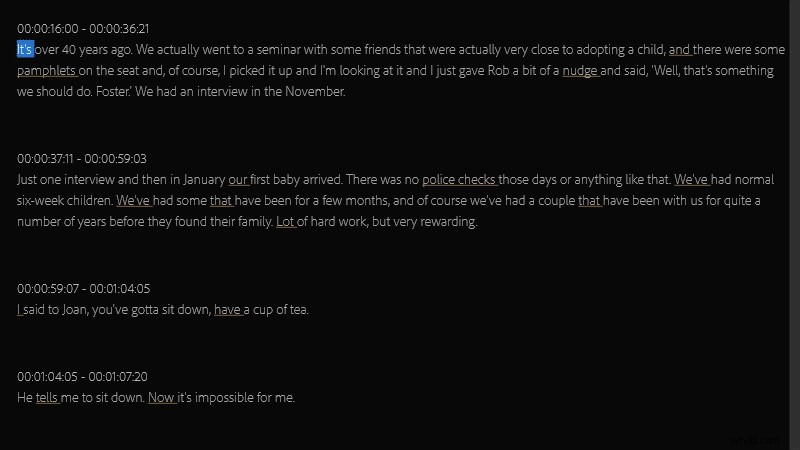

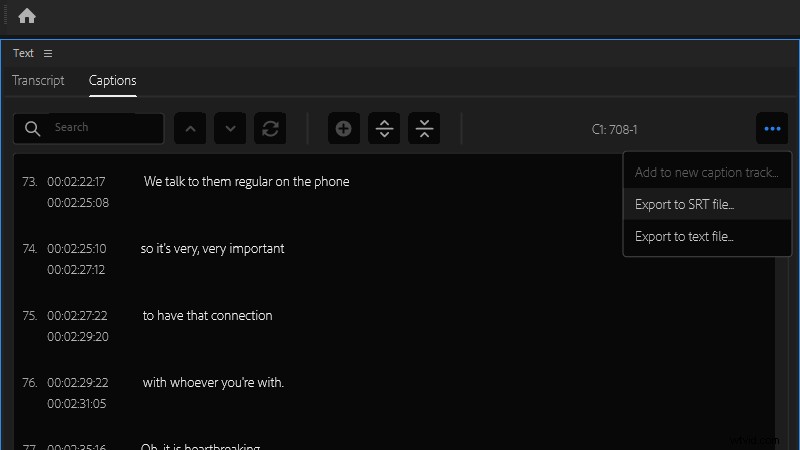

Lorsque Sensei a terminé votre audio, l'onglet Transcription du panneau Texte sera rempli avec les résultats.

Et bien que votre kilométrage puisse varier, je dois dire que j'ai été impressionné par la précision des tests que j'ai effectués. La version bêta que j'ai d'abord testée était bonne, la version publique est encore meilleure.

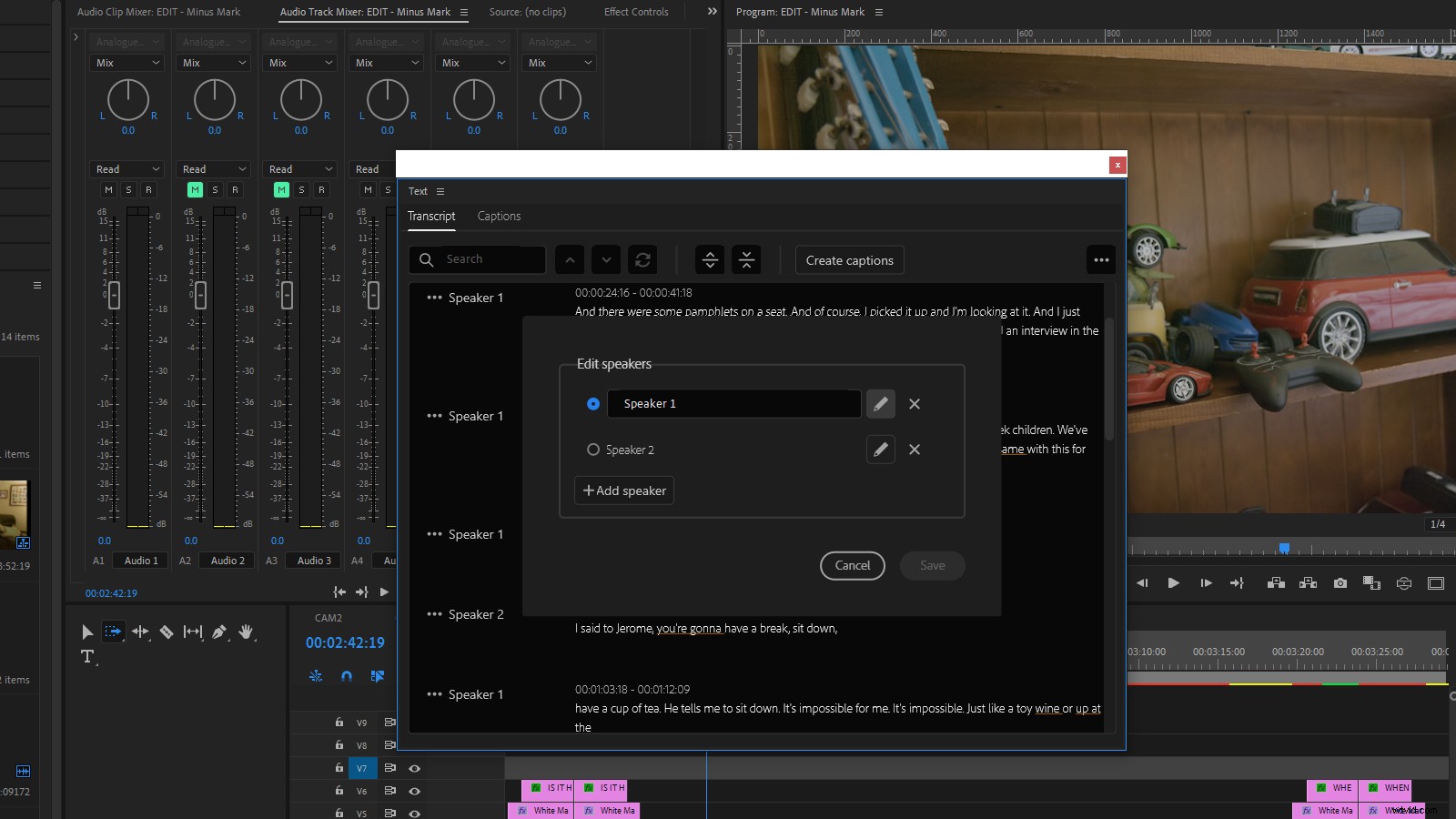

En optant pour le profilage de l'orateur, Sensei reconnaît plusieurs orateurs, les identifiant comme Orateur 1, Orateur 2, etc. Si vous vous désabonnez, il affichera simplement Inconnu à côté des segments de paragraphe.

Dans tous les cas, vous pouvez les nommer en cliquant sur les points de suspension dans la colonne de gauche de l'onglet Transcription et en sélectionnant Modifier les intervenants.

Cet outil peut vous permettre de corriger manuellement les cas où Sensei peut avoir identifié de manière incorrecte des locuteurs avec des voix similaires, et cela vaut la peine de prendre le temps de le faire maintenant avant de passer à l'étape de création de sous-titres.

Il en va de même pour le nettoyage des transcriptions. À moins que vous n'ayez été extrêmement chanceux avec votre analyse Speech-to-Text, il y aura des erreurs dans votre transcription. Ceux-ci sont plus susceptibles d'être enregistrés dans des enregistrements avec une diffusion plus conversationnelle, un bruit de fond, des mots non issus du dictionnaire comme des noms d'entreprise ou plusieurs orateurs qui se parlent.

Et bien que vous puissiez modifier le texte après sa conversion en sous-titres, vous devez corriger la transcription avant vous passez à l'étape suivante. Cela est dû au fait que Premiere Pro traite la transcription et les sous-titres suivants comme des sources de données distinctes. Ainsi, les modifications apportées à l'une n'auront aucun effet sur l'autre.

Prenez donc le temps de bien rédiger votre transcription, car ce sera la source à partir de laquelle tous vos sous-titres seront créés.

Se déplacer

Adobe a mis en place des fonctionnalités extrêmement utiles pour vous aider à naviguer dans la vidéo et la transcription en même temps.

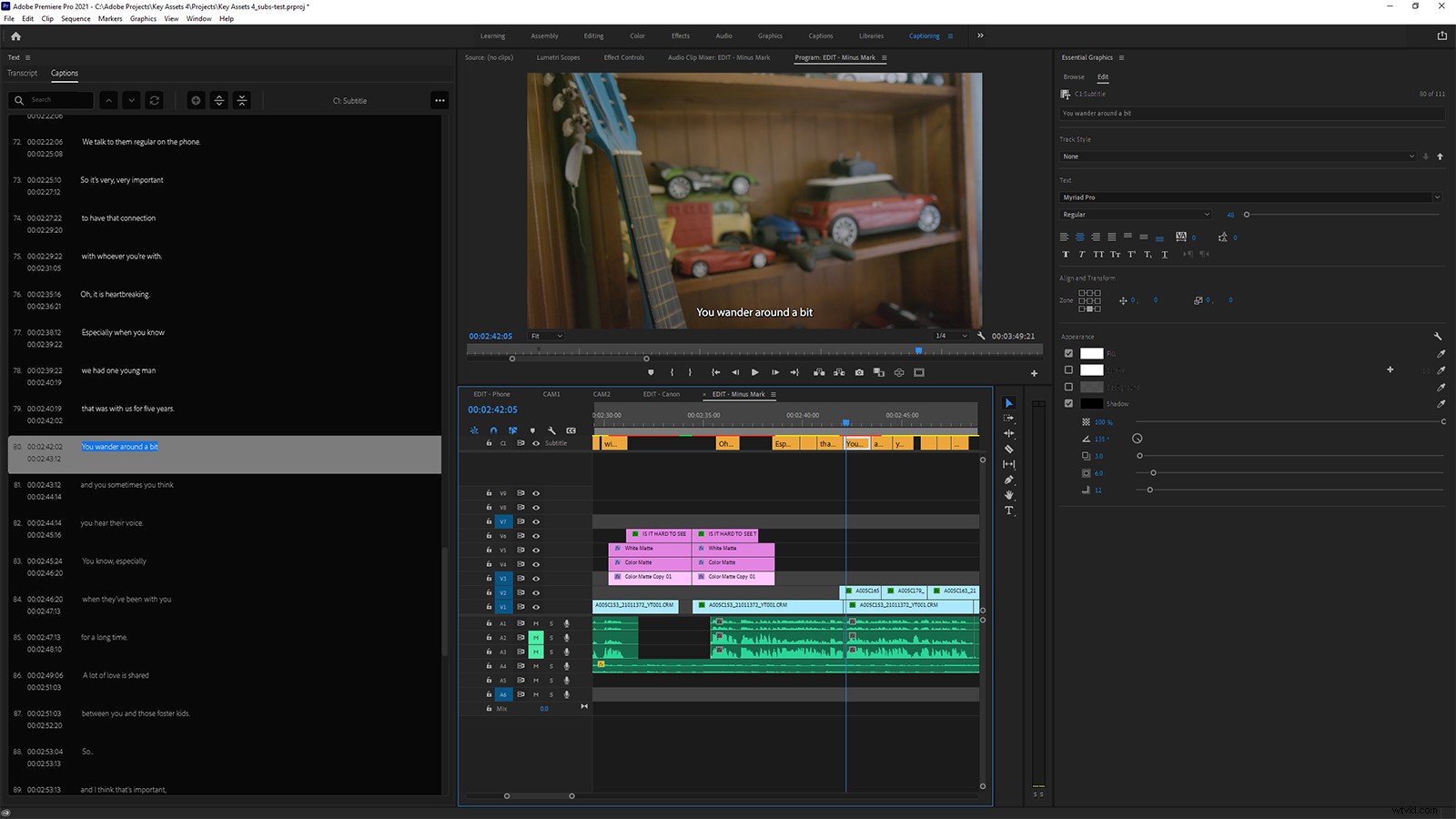

Pour commencer, Premiere Pro dispose déjà d'un espace de travail Sous-titres qui divise votre écran en texte, graphiques essentiels, chronologie, chutiers de projet et programme. Bien que vous souhaitiez peut-être modifier les choses en fonction de vos préférences. Pour moi, ça ressemble à ça…

Une fois que vous êtes configuré, trouver votre chemin est simple.

Par exemple, déplacer la tête de lecture vers une nouvelle position dans la chronologie positionnera automatiquement la transcription à l'emplacement correspondant, dans la mesure où le mot prononcé à ce point sous la tête de lecture est surligné en bleu dans le panneau Transcription. Tout texte qui se trouve devant la position de la tête de lecture est coloré en gris, ce qui est un ajout utile à l'UX.

De même, lire ou parcourir la chronologie mettra à jour la vue de la transcription pour suivre le rythme de la tête de lecture.

Et cela fonctionne également en sens inverse, donc la sélection de n'importe quel mot dans le panneau Transcription déplacera automatiquement la tête de lecture et l'aperçu vidéo à l'heure correspondante dans la séquence. Il peut parfois être un peu lent à répondre, peut-être parce qu'il communique avec les serveurs d'Adobe, mais c'est néanmoins une approche très efficace.

Il existe également une zone de recherche dans le coin supérieur, qui vous permet d'accéder directement aux mots et aux phrases de la transcription, ainsi qu'une fonction de remplacement si vous avez besoin de corriger des erreurs répétées.

Bonnes pratiques

À ce stade, vous effectuerez probablement la majeure partie de votre navigation dans le panneau Transcription ; en sélectionnant un mot, en appuyant sur Espace pour démarrer la lecture, en comparant ce que vous entendez avec ce que vous lisez, puis en vous arrêtant et en double-cliquant sur le texte pour apporter des modifications.

D'après mon expérience, vos modifications porteront très probablement sur la ponctuation et la structure des phrases, plutôt que sur la correction de mots incorrects. Et malgré tous les efforts de Sensei, vous devrez encore travailler pour que les choses soient prêtes pour les sous-titres.

Et c'est à prévoir. Le traitement du langage naturel est incroyablement dur. Après avoir pris en compte les accents, le dialecte, les manières, le ton et l'emphase, même les êtres humains ont du mal avec cela. Il est donc irréaliste d'attendre des résultats parfaits d'une machine. (Je vous recommande vivement d'activer les sous-titres automatiques de YouTube pour l'exemple vidéo suivant.)

(C'est une excellente alternative - https://youtu.be/Gib916jJW1o)

Alors abordez cette étape avec un esprit ouvert, une tasse de café frais et une chaise confortable. Et si vous avez besoin de conseils sur les meilleures pratiques pour la création de sous-titres, vous voudrez peut-être d'abord lire les directives de la BBC sur les sous-titres.

N'oubliez pas non plus que les données de transcription sont enregistrées dans le fichier de projet Premiere Pro, vous pouvez donc y revenir plus tard si nécessaire. Vous pouvez également exporter la transcription en tant que .prtranscript distinct mais propriétaire. fichier, bien que les avantages de cette approche ne soient pas clairs.

Prêt ?

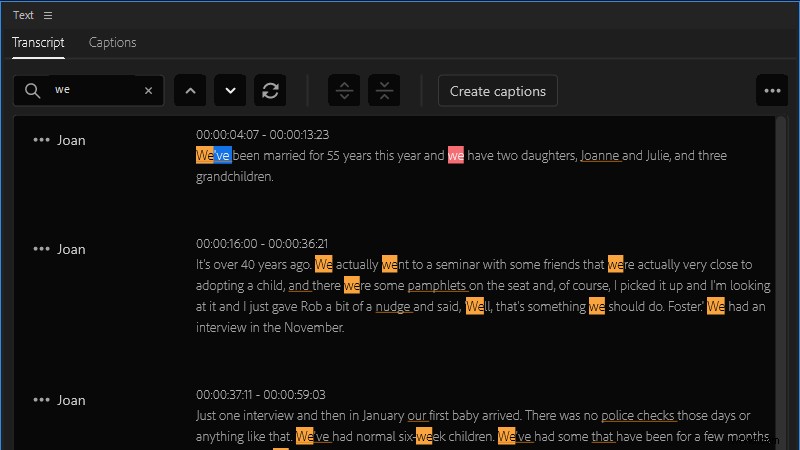

Lorsque vous êtes sûr que votre transcription est aussi propre que possible, alors allez-y et cliquez sur Créer des sous-titres bouton.

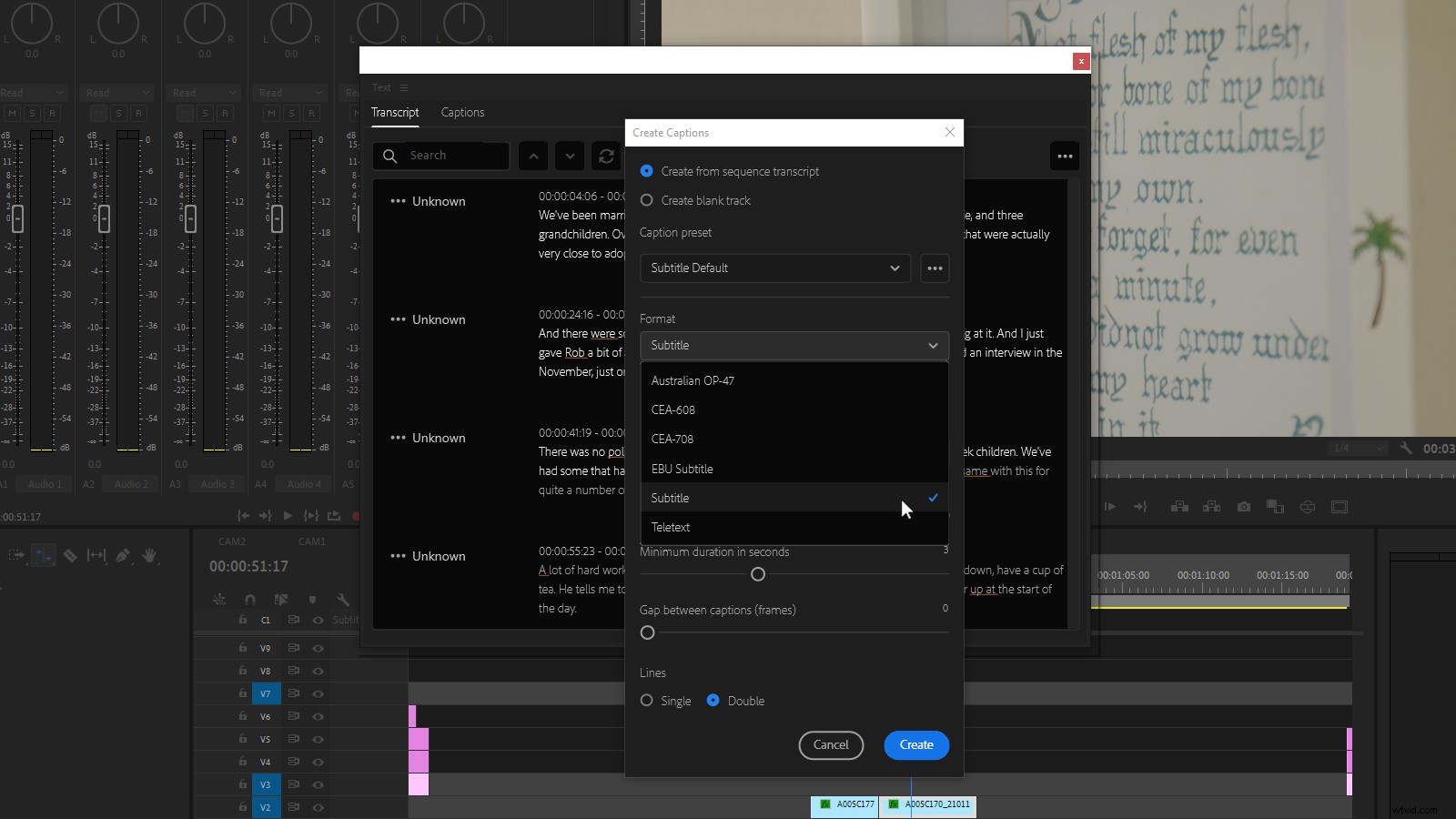

Vous aurez ici un tas d'options, y compris la possibilité d'appliquer des styles (en supposant que vous en ayez déjà créé). Vous pouvez définir la longueur maximale des caractères et la durée minimale de vos sous-titres, les définir sur Double ou Simple ligne, et même le nombre de cadres que vous souhaitez insérer entre eux.

Si vous n'êtes pas sûr de ce que vous voulez à ce stade, je vous suggère de choisir le format "Sous-titre" dans le menu déroulant, assurez-vous que le Créer à partir de la transcription de la séquence bouton radio est sélectionné et laissez le reste à leurs valeurs par défaut.

Je ne vais pas passer beaucoup de temps à discuter des différents formats de sous-titres proposés par Speech-to-Text. En partie parce que je ne suis pas un expert des différences et que vous connaissez mieux que moi les exigences de votre projet. Mais surtout parce que ça n'a pas tellement d'importance .

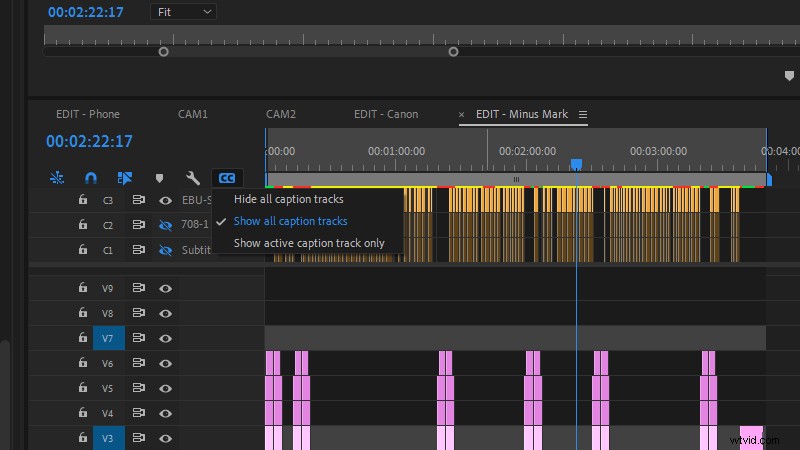

En effet, Speech-to-Text de Premiere Pro conserve vos données de transcription intactes et ajoute vos sous-titres à une piste distincte dans la chronologie de la séquence. (Il s'agit d'une énorme amélioration par rapport à la première tentative de sous-titrage de Premiere Pro, qui incorporait la piste de sous-titrage dans la couche vidéo.)

Grâce à cela, vous pouvez générer des légendes dans autant de formats différents que vous le souhaitez. Même rétroactivement, si votre projet devait être vendu sur un territoire qui utilise une norme différente. Il ne semble pas y avoir de limite au nombre de pistes de sous-titres que vous pouvez ajouter, et le format utilisé pour chaque piste de sous-titres est clairement étiqueté.

Si les choses commencent à être encombrées, vous pouvez basculer la visibilité de la piste à l'aide du bouton CC dans la vue de la chronologie.

Si vous travaillez avec des sous-titres en langue étrangère, cet aspect de l'interface utilisateur peut être extrêmement utile, car il a le potentiel de vous permettre de créer des couches de sous-titres pour autant de langues que vous le souhaitez dans la même chronologie de séquence . Il y a des limites à cette approche, que j'aborderai plus tard, mais d'après mon expérience personnelle, je m'en réjouis de tout cœur.

Alors allez-y et appuyez sur ce bouton Créer, et regardez votre transcription se décomposer et se présenter dans le format de votre choix.

Un autre tour

Si vous avez de l'expérience dans la création de sous-titres, vous saurez que de bons sous-titres nécessitent une finesse surprenante.

Ce n'est pas aussi simple que de diviser le dialogue en phrases et de les afficher à l'écran aussi longtemps qu'il faut à l'orateur pour les dire.

Vous devez déconstruire ce qui est dit en sections courtes et intelligibles qui peuvent être lues sans trop détourner l'attention des visuels. La ponctuation est extrêmement importante et les sauts de ligne peuvent faire la différence entre la compréhension et la confusion. Et pour être juste, Speech-to-Text semble faire un travail raisonnable à cet égard.

Cependant, pour vous conformer aux normes de sous-titrage telles que celles de la FCC, vous devez transmettre le bruit et la musique dans toute la mesure du possible . Et bien qu'il soit déraisonnable de s'attendre à ce que Sensei commence à étiqueter les bruits et la musique (pour l'instant, du moins), votre logiciel de sous-titrage devrait vous permettre d'incorporer des informations au-delà du dialogue.

Un à la fois, s'il vous plaît

Malheureusement, Speech-to-Text est limité à un seul piste sans portée pour les éléments qui se chevauchent.

Cela signifie qu'il n'y a aucun moyen d'intégrer facilement des haut-parleurs simultanés ou d'ajouter des identifiants sonores ou musicaux au cours du dialogue. (J'ai essayé de les ajouter à une deuxième piste de sous-titres, mais vous ne pouvez activer la visibilité que pour une piste à la fois.)

Donc, si la conformité FCC est nécessaire pour votre projet, vous devrez peut-être confier ce travail à une autre solution de sous-titrage. Mais même dans ce cas, vous pouvez toujours utiliser Speech-to-Text pour obtenir la plupart du temps, puis exporter les résultats vers un fichier texte ou SRT (SubRip) pour les importer dans un autre outil.

Répartissez la différence

Une fois que vous vous êtes mis à éditer les sous-titres générés par Speech-to-Text, le flux de travail de Premiere Pro prend tout son sens.

Les phrases sont divisées en courts segments d'une seule ligne qui s'adaptent même aux plus petits écrans sans retour à la ligne. Et vous pouvez choisir de les fusionner ou de les diviser davantage s'ils ne fonctionnent pas tout à fait dans leur état actuel.

L'ajout de nouvelles légendes est également possible, en supposant qu'il y a de l'espace pour le faire (la valeur par défaut pour la légende insérée est de trois secondes, et vous pouvez finir par écraser les légendes existantes si vous ne faites pas attention ici).

Les sous-titres se comportent également comme n'importe quel autre élément de la chronologie. Ainsi, vous pouvez ajuster leurs points d'entrée et de sortie en faisant glisser les poignées de clip, les lier à des clips vidéo, les diviser avec l'outil Razor ou même effectuer des modifications par glissement, glissement, ondulation et roulement.

Donc, si vous maîtrisez déjà l'ensemble d'outils Premiere Pro, vos compétences existantes vous seront très utiles ici.

Réparer en post-post

Il existe cependant une limitation d'édition de piste qui est propre aux sous-titres.

Bien que vous puissiez sélectionner et manipuler plusieurs pistes vidéo, audio ou image en même temps, une seule piste de sous-titres peut être active à la fois. Si vous avez besoin d'ajuster plusieurs pistes de sous-titres dans différents formats, vous devrez le faire une piste à la fois.

Mais cela ressemble à des cheveux en quatre. Étant donné que le processus de sous-titrage a généralement lieu longtemps après le verrouillage et l'approbation de la modification, la nécessité d'apporter des modifications à plusieurs formats de sous-titres devrait être un scénario marginal.

Ouvert ou fermé ?

Premiere Pro offre une large gamme d'outils de mise en forme pour vos sous-titres, y compris la possibilité d'enregistrer des styles et de les appliquer à de futurs projets.

Vous pouvez ajuster les options de police, de couleur, d'ombre, de contour et d'arrière-plan, ainsi que la position, l'alignement du texte et la zone de légende utilisable. Et ceux-ci peuvent être attribués à des sous-titres individuels ou à l'ensemble de la piste de sous-titres.

Sous-titrage

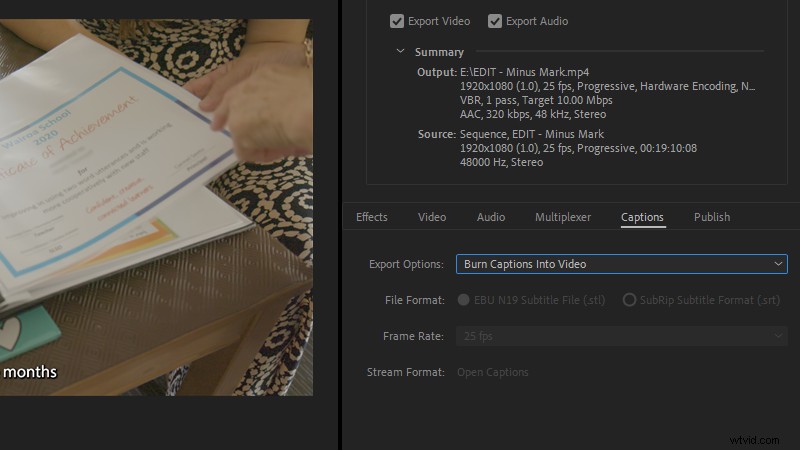

Mais la mesure dans laquelle vous pouvez modifier l'apparence de vos sous-titres dépend de votre intention de les déployer en tant qu'éléments ouverts ou fermé .

Les sous-titres codés sont stockés dans des fichiers séparés, également appelés fichiers annexes, et peuvent être activés et désactivés par le spectateur pendant la lecture.

La plupart du formatage des sous-titres codés est géré par le système de lecture, de sorte que les options de formatage sont limitées (et Premiere Pro n'affichera que les fonctions prises en charge par le format de sous-titrage que vous avez choisi). Mais, malgré leur nom, les sous-titres sont plus faciles à modifier après avoir été finalisés, car il s'agit généralement d'un simple fichier texte ou XML.

Ouvrir le sous-titrage

En revanche, les sous-titres ouverts sont "incrustés" dans la vidéo, ils sont donc toujours visibles (quel que soit la plate-forme ou l'appareil de lecture) et vous pouvez les formater comme bon vous semble.

Cela signifie également que vous pouvez créer une version unique de la vidéo sous-titrée qui sera lue sur toutes les plateformes vidéo.

Mais le compromis ici est que vos sous-titres ne peuvent pas être modifiés sans recréer et redistribuer l'intégralité de la vidéo. Et, si vous travaillez avec plusieurs langues, vous devrez créer des vidéos entièrement nouvelles pour chaque langue au lieu d'un ensemble plus gérable de pistes de sous-titrage.

Il convient également de noter que les sous-titres ouverts seront redimensionnés avec la vidéo, donc si votre public regarde un média 16 × 9 en mode portrait sur un appareil mobile, il est possible que vos sous-titres deviennent trop petits pour être lus.

Sur cette base, vous pourriez penser qu'il n'y aurait aucune raison impérieuse d'opter pour des sous-titres ouverts sur votre contenu vidéo. Mais si vous publiez sur les réseaux sociaux, vous ne voudrez peut-être pas vous fier aux outils de sous-titrage automatique qui sont actuellement votre seule option sur des plateformes comme Instagram ou TikTok.

De plus, certaines plateformes sociales vous permettent uniquement d'ajouter des sous-titres en même temps que vous téléchargez la vidéo, ce qui rend impossible la planification ou la publication automatique de contenu vidéo avec des sous-titres. Le sous-titrage ouvert peut donc toujours être une option viable.

| YouTube | Instagramme | TikTok | |||

| Télécharger les sous-titres | Y | Y | Y | Y | N |

| Générer automatiquement les sous-titres | Y | Y | N | N | Y |

| Planifier une vidéo sous-titrée | Y | Y | N | N | N |

Finir

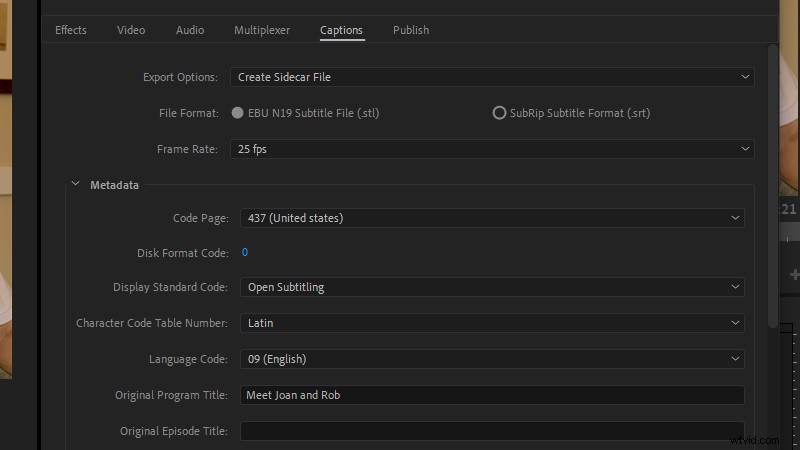

En regardant la version actuelle, il semble que vos options d'exportation aient été réduites à EBU N19 ou au fichier SubRip SRT en texte brut - le format MacCaption VANC MCC et Intégrer dans le fichier de sortie option trouvée dans la version bêta ne sont plus disponibles.

Ce n'est pas aussi limité qu'il y paraît, car EBU dessert la plupart des services de streaming et de diffusion, et SRT couvre la plupart des plateformes vidéo en ligne et sociales.

Ce que nous ne voyons pas, c'est la possibilité d'exporter uniquement la piste de sous-titres de l'outil d'exportation de Premiere Pro ou d'Adobe Media Encoder, vous devez donc restituer au moins un fichier audio afin d'obtenir un fichier de sous-titres XML.

Étant donné que vous pouvez exporter vers des fichiers .srt et .txt à partir du panneau Légendes, cela semble étrange et susceptible de changer à l'avenir.

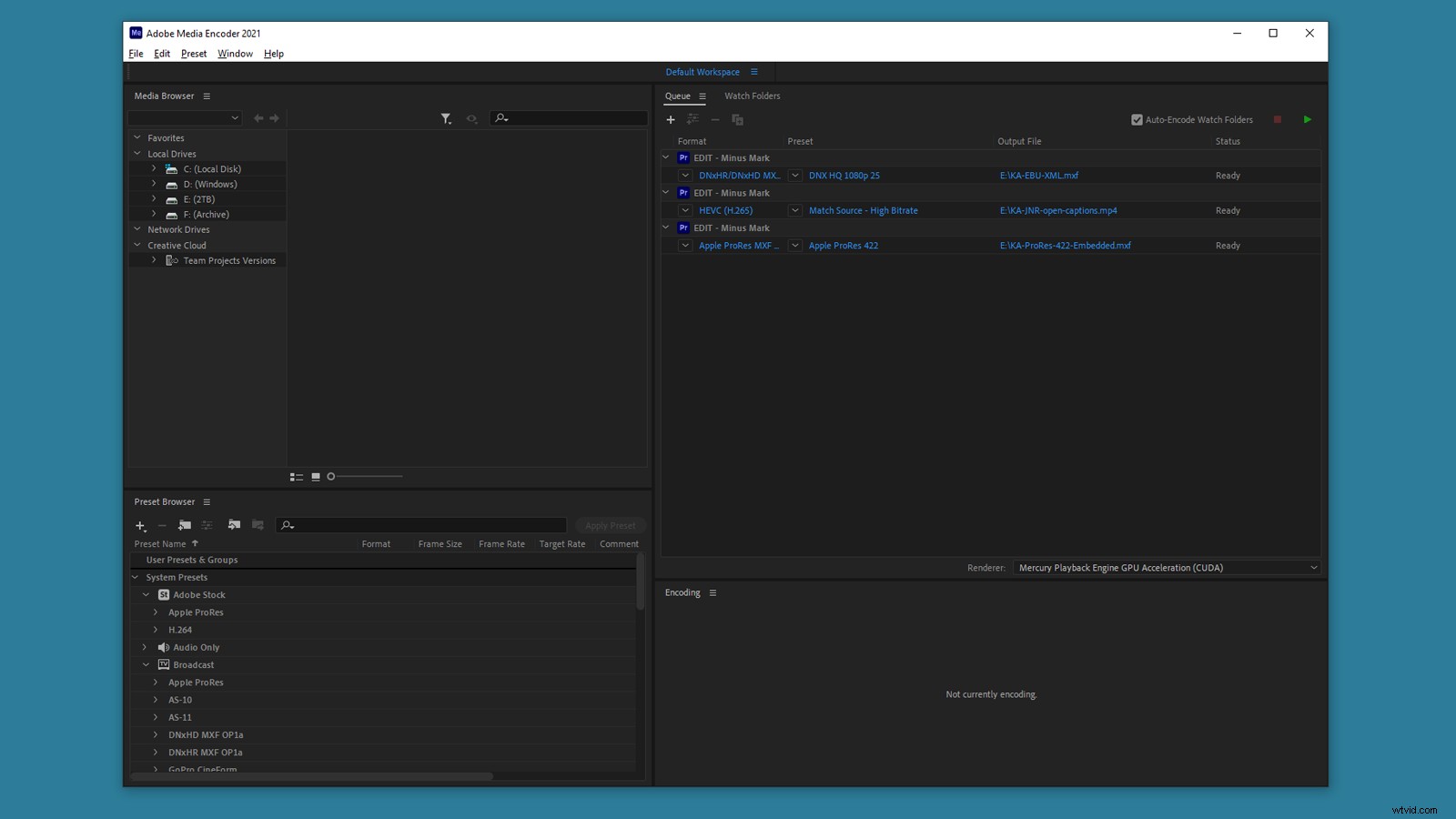

Si vous voulez des sous-titres ouverts, vous pouvez simplement choisir l'option Graver les sous-titres dans la vidéo option. Et bien sûr, si vous souhaitez créer plusieurs exportations dans différents formats, vous pouvez les mettre en file d'attente dans Adobe Media Encoder pour l'exportation par lots. Assurez-vous simplement de définir d'abord la visibilité de la piste de sous-titres requise dans la chronologie.

Que manque-t-il ?

Lors du test de la version bêta, j'ai noté certains domaines dans lesquels Adobe pourrait améliorer cet outil avant de le rendre public et, à une petite exception près, ils sont toujours "manquants". Voici donc ma liste de souhaits :

- Taille de police ajustable dans les panneaux Transcription et Légendes.

La taille du texte est actuellement définie par les paramètres système, et il y a des moments où j'ai voulu augmenter la taille de la police pour faciliter les choses. lu lors de la modification de la transcription. - Importation de scripts.

Si vous travaillez avec du matériel scénarisé, alors Speech-to-Text pourrait, en théorie, ignorer le processus de transcription et se concentrer plutôt sur le timing. Cela vous permettrait de convertir rapidement ce que vous avez déjà dans un format prêt pour les sous-titres. (YouTube l'a déjà.) - Mise en forme personnalisée basée sur le locuteur.

Bien que vous puissiez identifier les locuteurs dans la transcription, il n'y a aucun moyen d'ajouter automatiquement ces données à vos sous-titres. Et si vous sous-titrez scène par scène, il peut être utile d'avoir un placement de sous-titres personnalisé pour les intervenants qui seront toujours d'un côté particulier de l'image.

Mais est-ce que ça vaut le coup ?

Je ne peux pas dire quelle pourrait être votre expérience avec la synthèse vocale de Premiere Pro.

S'agit-il d'une automatisation à un seul bouton pour tous vos besoins de sous-titrage ? Bien sûr que non. Et je crois que nous sommes encore loin de construire un système capable de gérer cette tâche complexe et infiniment variable sans aucune intervention humaine.

Mais pour moi, cet outil est devenu une inclusion standard dans ma boîte à outils avant même qu'il ne quitte la version bêta.

Si vous appuyez dessus, j'estimerais que cela réduit le temps nécessaire pour sous-titrer le contenu à environ un tiers de ce qu'il était auparavant . It’s not the only option available—Otter.ai will export transcripts to the .srt caption format, Digital Anarchy has a Premiere Pro plugin called Transcriptive, and of course, you can pay companies to do the job for you—but all of these have a cost component, while Speech-to-Text is currently free to use.

It all comes back to that comment I included at the beginning of this article—is it easier to use Speech-to-Text than it would be to transcribe it yourself? For me, the answer is a very firm yes. So if you’re looking at finding a better way to add accessibility and greater audience engagement to your video projects, Premiere Pro Speech-to-Text is definitely worth a look.

(And if you’re looking for more content on working with audio in Premiere Pro, check out Premiere Pro Mixing Basics and Premiere Pro Audio Tools.)